深度适配 Qwen3.5,AI 体验拉满

Intel Arc Pro B60的推理软件栈LLM-Scaler-vLLM目前已适配 Qwen3.5 大模型,原生支持256K 超长上下文,处理百万字长文档、大篇幅数据分析、超长指令任务时毫无压力;同时实现32Token/S 高吞吐量,指令响应速度快,交互体验流畅,让 “龙虾” 的思考与执行更高效。

原生多模态支持,更适合“养龙虾”

铭瑄 Intel Arc Pro B60 系列显卡原生支持文本、图像、视频多模态输入,让OpenClaw不仅能处理文字类任务,还能直接解析图片、视频内容,解锁图片分析、视频剪辑辅助、多模态内容创作等更多场景,让 “龙虾” 的能力边界持续拓展,适配更丰富的实际应用需求。

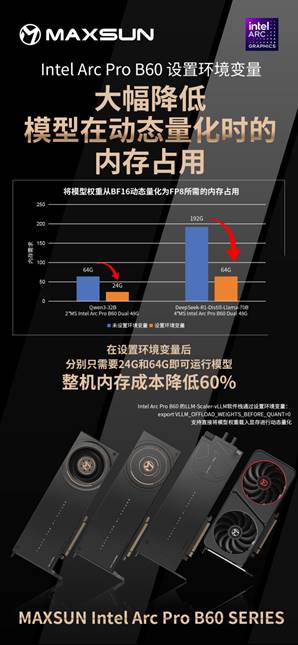

大模型的推理、量化、多模态处理都对显卡的显存提出了挑战。随着内存价格的上涨,用户想要获得更高性能,装机成本也相对更为高昂。动态量化是让大模型在有限显存上运行的关键技术,但传统方式往往需要先将权重加载到内存再转换,导致显存占用高、速度慢。铭瑄 Intel Arc Pro B60系列显卡通过设置环境变量,能大幅降低模型在动态量化时的内存占用,从而实现在维持运行性能的同时,降低整机内存成本。

如图所示,在未设置环境变量时,双卡MAXSUN Intel Arc Pro B60 Dual 48G 显卡运行Qwen3-32B模型需要内存64G,而设置环境变量后只需要24G即可运行;四卡MAXSUN Intel Arc Pro B60 Dual 48G 显卡运行DeepSeek-R1-Distill-Llama-70B模型需要内存192G,而设置环境变量后只需要64G即可运行。换而言之,在设置环境变量后,分别只需要24G和64G即可运行模型,整机内存成本预计降低60%!(Intel Arc Pro B60的LLM-Scaler-vLLM软件栈通过设置环境变量:export VLLM_OFFLOAD_WEIGHTS_BEFORE_QUANT=0

支持直接将模型权重载入显存进行动态量化)

快来选择铭瑄 Intel Arc Pro B60系列显卡,轻松养出你的高效能 “龙虾” 吧!

*注:文中所示数据来源铭瑄实验室,实际可能存在部分差异